Il sistema di riconoscimento facciale fornito alla polizia statunitense (e non solo) solleva l’allarme dei difensori dei diritti civili

Finché è uno stato autoritario come la Cina a dotare la polizia di visori in grado di identificare le persone in tempo reale, c’è poco da stupirsi. I timori che la sorveglianza di massa si stia diffondendo anche nel mondo occidentale, però, hanno appena trovato una nuova conferma: la ACLU (American Civil Liberties Union) ha diffuso una serie di documenti pubblici che dimostrano come Amazon stia promuovendo e vendendo alle forze dell’ordine un programma per il riconoscimento facciale, chiamato Amazon Rekognition.

Finché è uno stato autoritario come la Cina a dotare la polizia di visori in grado di identificare le persone in tempo reale, c’è poco da stupirsi. I timori che la sorveglianza di massa si stia diffondendo anche nel mondo occidentale, però, hanno appena trovato una nuova conferma: la ACLU (American Civil Liberties Union) ha diffuso una serie di documenti pubblici che dimostrano come Amazon stia promuovendo e vendendo alle forze dell’ordine un programma per il riconoscimento facciale, chiamato Amazon Rekognition.

Rekognition è un software che può essere incorporato nelle telecamere disseminate per le città – o nelle videocamere da divisa in dotazione, per esempio, alla polizia statunitense – per identificare in tempo reale le persone riprese nei video: “È una ricetta per l’autoritarismo”, ha affermato Malkia Cyril di Black Lives Matter, una delle prime personalità a mettere in guardia sui rischi connessi a questo tipo di dispositivi. “Amazon non dovrebbe in alcun modo avvicinarsi a questo genere di cose. E se avremo voce in capitolo, non succederà”.

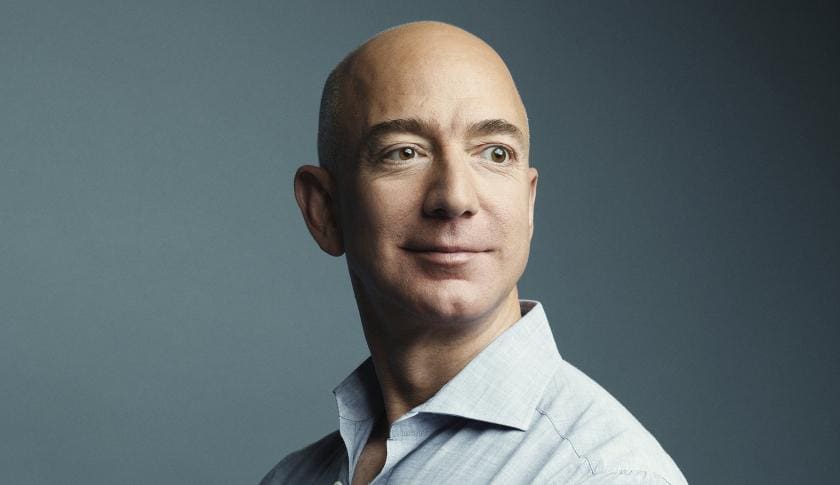

Una quarantina di associazioni, compresa la ACLU, hanno infatti inviato una lettera al CEO di Amazon, Jeff Bezos, per chiedergli di interrompere subito la vendita ai governi di questi strumenti per la sorveglianza; che “rendono sempre più facile violare i diritti civili e prendere di mira la comunità di colore”. Una presa di posizione contestata da Amazon, che in una dichiarazione inviata via email ha sottolineato come “la nostra qualità della vita peggiorerebbe se mettessimo fuorilegge determinate tecnologie solo perché qualcuno potrebbe abusarne. Dovremmo vietare l’uso dei computer perché si possono utilizzare anche a fini illeciti?”.

Nella dichiarazione, Amazon ha illustrato alcuni dei modi in cui gli strumenti per il riconoscimento facciale possono rendersi utili: “Per esempio, possono aiutare a trovare facilmente i bambini che si perdono nei luna park o le persone smarrite. In più, ai nostri clienti è richiesto di osservare la legge e usare questi software in modo responsabile”.

I possibili utilizzi di questa tecnologia, però, non sono tutti così innocenti: secondo quanto riportato dal Guardian , il direttore del programma Rekognition, Ranju Das, ha illustrato durante una conferenza tenuta a Seoul in che modo la polizia di Orlando, Florida, stia utilizzando il software per il riconoscimento facciale: “Ci sono telecamere in tutta la città: possiamo analizzare i video in tempo reale e identificare i volti presenti nei database delle forze dell’ordine”.

Ma quali sono i pericoli per la società civile? Secondo Malkia Cyril, il rischio è di fornire alla polizia strumenti che rendono sempre più facile abusare dei propri poteri. Non solo: nei paesi non democratici, questi software possono facilitare l’individuazione di dissidenti e persone sgradite ai regimi; o l’identificazione dei partecipanti alle manifestazioni antigovernative.

Se non bastasse, i software per il riconoscimento facciale (e più in generale per il riconoscimento immagini) sono considerati lo strumento fondante per lo sviluppo delle armi autonome e dei cosiddetti killer robots; che – secondo gli esperti – rischiano di diffondere su scala sempre più vasta i conflitti armati.

Andrea Daniele Signorelli, La Stampa.it